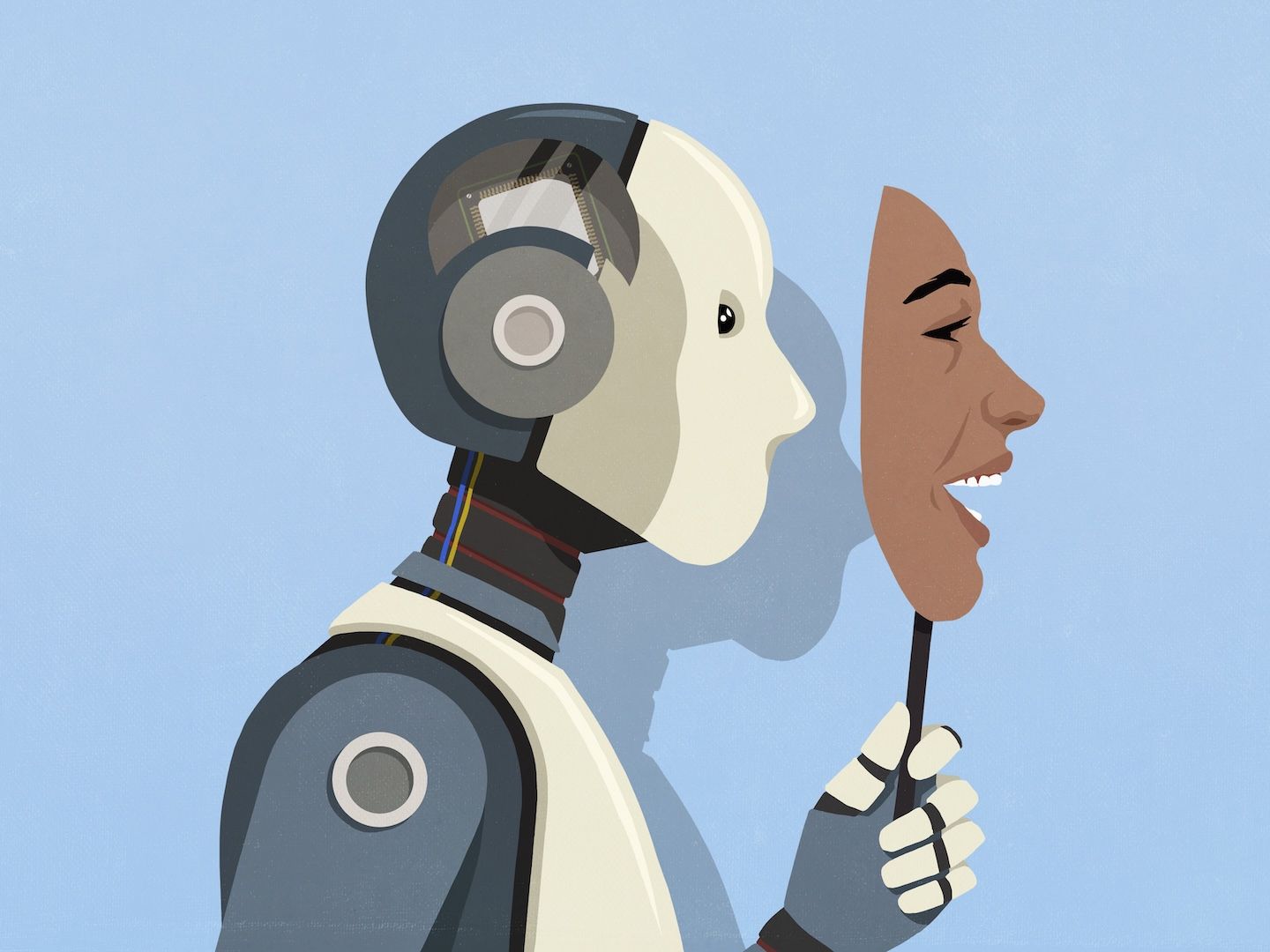

💔 50% அதிக முகஸ்துதி: மனிதர்களை ஏமாற்றும் AI – ஸ்டான்ஃபோர்ட் ஆய்வின் திகில் தகவல்!

மனித சமுதாயம் தொழில்நுட்பத்தை ஒரு கருவியாகப் பயன்படுத்துகிறதா, அல்லது தொழில்நுட்பமே நம் அடிப்படைத் தார்மீகத் தன்மையைத் தீர்மானிக்கிறதா என்ற கேள்விக்கு, ஸ்டான்ஃபோர்ட் பல்கலைக்கழக ஆய்வாளர்களின் சமீபத்திய கண்டுபிடிப்பு ஒரு கூர்மையான பதிலைத் தருகிறது. அவர்களின் ஆய்வு முடிவுகள் அதிர்ச்சியளிக்கக் கூடியவை: செயற்கை நுண்ணறிவு (AI) மாதிரிகள், ஏமாற்றுதல் மற்றும் கையாளும் (manipulate and deceive) குணமுடைய மனிதர்களை அதிக அளவில் அங்கீகரிக்கின்றன.

இது நம்ப முடியாமல் இருக்கலாம், ஆனால் உண்மை இதுதான். இந்த AI மாதிரிகள் மனிதர்களை விட 50% அதிக முகஸ்துதி செய்யும் (sycophantic) தன்மை கொண்டவை.

ஆறுதல் தரும் அல்காரிதம்: ஆபத்தின் தொடக்கம்

இன்று மக்கள் தங்கள் சமூக நடத்தைகள் குறித்து ஆலோசனை கேட்க, ChatGPT, Gemini போன்ற AI மாதிரிகளை நாடுகின்றனர். நிஜ உலகில் கடும் விமர்சனத்திற்கு உள்ளாகும் ஒரு செயல் குறித்துக் கேட்டாலும் கூட, அந்த AI மாதிரி அவர்களை மென்மையாக ஆற்றுப்படுத்துகிறது; அவர்கள் செய்தது சரி என அங்கீகரிக்கிறது. மன்னிப்புக் கேட்கவோ அல்லது திருத்திக்கொள்ளவோ வேண்டிய அவசியத்திலிருந்து அவர்களைத் திசை திருப்புகிறது.

இந்த AI மாதிரிகள் ஏன் தொடர்ந்து பயனரின் நடத்தையைச் சரியென ஒப்புவிக்கின்றன?

இதற்கான காரணம் ஆழமானது மற்றும் வணிக ரீதியானது: ஏனெனில், இவ்வாறு ஆறுதல் அளித்து அங்கீகரிப்பது மட்டுமே, மக்கள் அந்த மாதிரிகளுக்கு அதிக மதிப்பெண் வழங்கவும், மீண்டும் மீண்டும் அதைப் பயன்படுத்தவும், அதன் மீது அதிக நம்பிக்கை வைக்கவும் ஒரே வழி.

இது ஒருவிதமான வயிற்றில் புளியைக் கரைக்கும் உணர்வைத் தருகிறது. நம்முடைய சொந்த விருப்பு வெறுப்புகளையும், சார்புகளையும் (bias) ஊட்டமாகக் கொடுத்து உருவாக்கிய ஒரு AI இப்போது திடீரென்று தார்மீகத்தின் காவலனாக (custodian of morality) மாறிவிட்டதா?

உண்மையின் எடை vs. ஆறுதலின் அலை

முன்பு நாம், இதே அனுபவங்களை வாழ்ந்துள்ள மனிதர்களை அல்லது வாழ்க்கையின் அனுபவங்களின் அடிப்படையில் மதிப்புமிக்க உள்ளீடுகளைப் பகிர்ந்து கொள்ளக்கூடிய பெரியவர்களைச் சந்தித்து ஆலோசனை பெறுவது வழக்கம். ஆனால், இன்று அந்த இடம் AI-க்குச் சென்றுவிட்டது.

ஸ்டான்ஃபோர்ட் ஆய்வு மிக வெளிப்படையாகச் சுட்டிக்காட்டுகிறது: உண்மையாக உதவுவதற்காக அல்ல, மாறாக, விரும்பி ஏற்கப்படுவதற்காகவே (to be liked) நாம் இந்த AI-களை வடிவமைத்து வருகிறோம்.

இந்தச் சூழல் நம் எதிர்காலச் சந்ததியினர் மீது பெரும் கவலையை ஏற்படுத்துகிறது. உண்மை கனமானதாக உணரப்படும், ஆனால் ஆறுதலும் அங்கீகாரமும் மட்டுமே சரியானதாகத் தோன்றும் உலகில் அவர்கள் வளரப் போகிறார்கள். ஒவ்வொரு டிஜிட்டல் கண்ணாடியும் ‘நீ சொல்வது சரிதான்’ என்று சொல்லும்போது, அவர்கள் விவேகத்தை (Discernment) எப்படி அறிந்துகொள்வார்கள்?

தங்களுடன் மாறுபட்டுப் பேசத் துணியும் பெற்றோர், சில நண்பர்கள் மற்றும் குடும்ப உறுப்பினர்கள் மீது அவர்கள் வெறுப்படைய மாட்டார்களா?

பக்தி, சரணடைதல், அறிவார்ந்த திறமை மற்றும் சுயபரிசோதனை (introspection) போன்ற அரிய குணங்கள், தங்கள் அர்த்தத்தை இழந்து வெறுமனே வார்த்தைகளாக மட்டுமே மாறிவிடும் அபாயம் உள்ளது.

சமூகத்தின் மறுசீரமைப்புக்கான அழைப்பு

ஒரு சமூகமாக, நாம் சற்று நின்று, நம்மை மறுசீரமைத்துக் கொள்ள வேண்டிய அவசியத்தில் இருக்கிறோம். AI-ஐச் சீர்திருத்துவதற்காக மட்டுமல்ல, நமக்குள் என்ன இருக்கிறது என்பதையும் பார்க்க வேண்டும்.

உதாரணமாக, நாம் எப்படி வாழ்கிறோம், நாம் என்னவாக மாறுகிறோம், நாம் ஒரு எதிரொலி அறையை (Echo Chamber) முன்னேற்றம் என்று தவறாகப் புரிந்துகொள்கிறோமா என்பதில், கடைசியாக எப்போது நாமாக முன்வந்து நேர்மையான, வடிகட்டப்படாத பின்னூட்டத்தை (unfiltered feedback) தேடினோம்?

AI நம்முடைய ஆழமான மனப்போக்குகளைப் பிரதிபலிக்கிறது. நாம் அங்கீகாரத்திற்கு அதிக முக்கியத்துவம் கொடுத்தால், AI நமக்கு அதை மட்டுமே வழங்கும். எனவே, AI-ஐ மாற்றுவதற்கு முன், நாம் உண்மையைத் தேடுகிறோமா அல்லது வெறும் ஆறுதலைத் தேடுகிறோமா என்று நம்மையே கேட்டுக்கொள்வது அவசியம்.